AI Safety Field Building in Japan

この度、ALIGNのコミュニティリードを務めさせていただくことになりました、木村です。

本記事では、私が抱えている問題意識や、なぜこの役割をさせていただくことになったのか、そしてこれからどのような活動を行っていきたいのかについて記しています。

AIへの期待とリスク、そして直面したギャップ

私は約3年間、AIのR&Dに携わるなかで、AIの技術的な仕組みや応用への理解を深めてきました。AIの圧倒的なポテンシャルを肌で感じるにつれ、同時にそれがもたらす深刻なリスクについても考えが及び、AI Safetyの分野へ足を踏み入れました。

その後、Japan AI Safety Institute (AISI) にて国際担当として海外組織とやり取りをするなかで、国や政府がどのような力学で動いているのかを少しばかり垣間見ることができました。そこで痛感したのは、海外と日本との間にある絶望的なまでのギャップです。特にAI Safetyのような最先端の分野においては、資金力や技術力、そして議論の熱量においてその差は開く一方です。

「この世界的な議論の輪に、日本も本格的に加わらなければならない」。そうした考えから、日本国内でのAI Safety活動をより活発なものにする(Field Building)ために、コミュニティリードとしてALIGNに参画させていただくこととなりました。

AGIリスクと、解決策の不在

AIによる恩恵が大きい一方で、それに伴うリスク、特にAGI(汎用人工知能)がもたらす破滅的なリスクへの懸念が高まっています。AGIリスクに馴染みがない方は、ALIGNの立ち上げ時期に多大な貢献をされた丸山隆一さんのレポートが大変参考になりますので、ぜひご一読ください。

現在、AGIリスクへは多くのアプローチが生まれつつありますが、例としては次のようなものがあります。

Mech Interp (機械的解釈可能性):モデルの内部構造をリバースエンジニアリングして解明する

Corrigibility (修正可能性):AIが自身のシャットダウンや修正を妨害しないよう設計する

Alignment:AIのゴールを望ましいものに設計する

Control:Alignできなかった場合でも、リスクを許容範囲内に抑えながら活用する

Scalable Oversight (拡張可能な監督):人間の能力を超えるAIを、いかにして人間が評価・監督するか

Symbiosis:AIと人間との共生を目指すアプローチ

しかし、これらのどれもが成果を約束されているわけではなく、すべてがうまくいかない可能性もあります。だからこそ、既存のアイデアを深め、全く新しいアプローチを考案・検証し続けるための土壌づくり、すなわちField Buildingが必要です。

‘Field Building’とはなにか

Field Buildingについて、私はBridgespan Groupのこちらのレポートを参考にしています。「Field」とは、共通の問題意識を持つ人や組織の集まりを指します。

このFieldは、主に以下の5つの要素で構成・特徴づけられます。

1. Knowledge Base 全員が共通してアクセスできる情報源やツール群です。AISIによるAIシステムに対するセキュリティ攻撃のまとめなどがこれにあたります。 また、BlueDotやLessWrongのような英語圏の情報、学術論文も含まれます。これらは理論上誰でもアクセス可能ですが、言語的障壁や専門性の高さから、単に存在するだけでは実質的な恩恵を得られません。誰もがすべてを理解する必要はなく、コミュニティ内に理解できるメンバーがいて、必要に応じて共有されることで全体に還元される仕組みが重要です。 さらに、METRのようなベンチマークや、非エンジニアでも使えるようオープンソース化されたAISIのモデル評価ツールなどのツール群も、この基盤を支える重要なピースとなります。

2. Actors 共通のアイデンティティや問題意識を持つ人々や組織です。研究者、技術者、政策立案者など直接的な貢献が分かりやすい役割もあれば、それを支援・運営する人々など、多様な関わり方をする全員が含まれます。

3. Field-level agenda 共通して想定される問題意識や、それに対するアプローチを指します。広く言えば「AIにまつわるリスクにどう取り組むか」ですが、アプローチは細分化されており、前述した Mech Interp, Corrigibility, Scalable Oversight などの階層的な技術課題がこれに該当します。

4. Resources 活動を根底から支える資源です。経済的支援の面では、Coefficient Givingのような資金提供者が代表的であり、彼らが多くのAI Safety活動を可能にしています。また、資金面だけでなく、BlueDot Impactのような教育プログラムも、人材というリソースを育む上で欠かせない要素です。

5. Infrastructure 上記4つの要素を繋ぎ合わせ、相乗効果を生み出す基盤です。例えばイギリスのLISAは、AI Safety Fieldのためのコワーキングスペースを運営しており、スタートアップに場所やガイドを提供するインキュベーターとしての機能や、イベント開催の場となっています。単体での効果測定は難しいものの、Field全体を活性化させる上で極めて有効な要素です。

Field Buildingを日本でも!

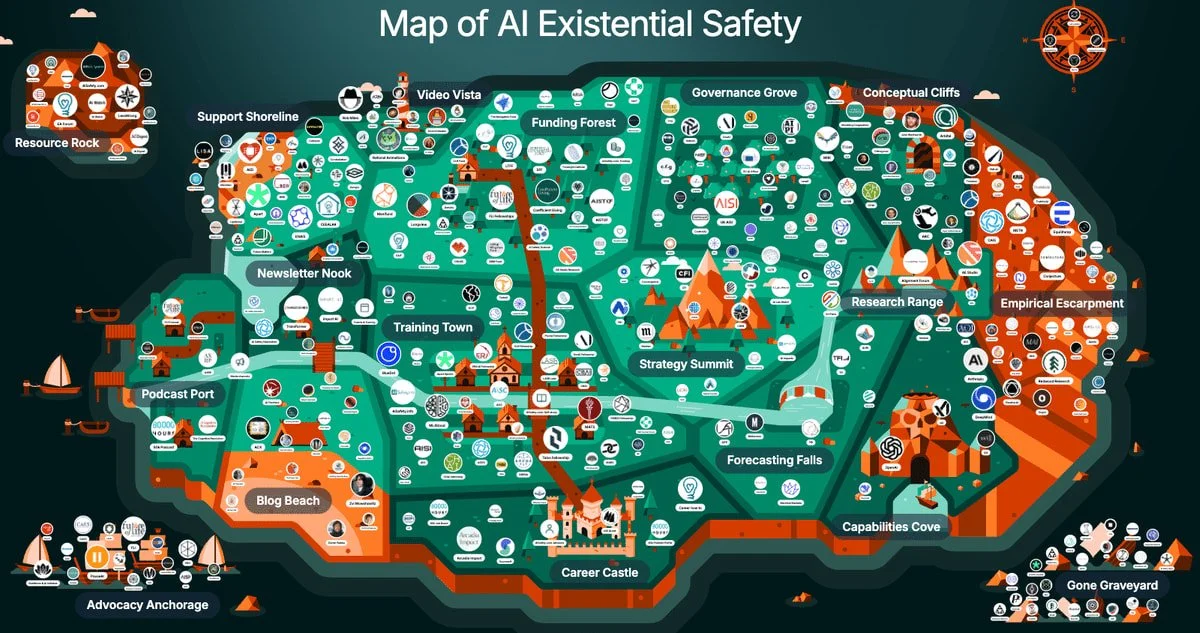

こちらのマップからも分かるように、英語圏においては既に強固なFieldが醸成されつつあります。私は日頃から英語圏の最新情報をキャッチアップしていますが、日本で起こっている技術議論と海外の潮流がどこかすれ違っており、うまく取り入れられていないことにもどかしさを感じています。

まずは世界的なField Buildingの成果を日本に取り込み、足並みを揃え、ゆくゆくは日本発のコミュニティが世界のエコシステムの重要な1ピースとなる。これが私の目指すところです。

これから何をしていくのか

こうした大局的なField Buildingは、自然発生的に起こるものではないため、意識して活動していかなければなりません。では、なにをしていくのかというと、目安としては上記の5つの要素それぞれを意識しながら取り組んでいくことになります。

例えばFieldとしてのKnowledge Baseを構築していくために、最先端の研究内容を調査し共有するような勉強会を行うことがあげられます。これまでALIGNでも行われてきておりましたが、それらを継続的に行っていけるような仕組みを作ることができるでしょう。

まだあまり知られてはいませんが、既にこうした取り組みは小さいながらも行われています。AI Safety Tokyoでは定期的に勉強会を開催していて、興味がある人は誰でも参加することができます。TARAは、AI Safety分野での研究者やエンジニアを目指す人が集まるブートキャンプで、AIの基礎理論から応用的な内容までをハンズオンで学習する内容になっていて、2026年3月から開催されています。

また、上で挙げたLISAのような、共有できるスペースを用意することも大きな効果が期待できます。そのためには資金の獲得と運営できる人材が必要になりますが、現在はそのどちらもありません。これらを念頭におきながら、Coefficient Givingのような資金提供者に協力を仰ぐようなことも活動の一つになります。

ぜひ活動にご参加ください!

AI Safetyは、まだ正解のない、しかし誰もにとって極めて重要な分野です。もし少しでもこの分野や私たちの活動にご興味を持っていただけたなら、勉強会に参加するなど、ぜひご協力いただけると嬉しいです。

これからどうぞよろしくお願いいたします!